In Genf wird, wenn man so will, gerade die Zukunft des Krieges verhandelt. Die Vereinten Nationen haben zur Konferenz über die „Konvention über bestimmte konventionelle Waffen“ geladen. Der sperrige Name verrät nicht, worum es im Kern geht. Der Elefant im Raum sind autonome Waffen, die ohne das Zutun von Menschen handeln – und ob diese reglementiert werden sollen.

Denn die Zukunft des Krieges hat längst begonnen. Bewaffnete Drohnen werden immer wichtiger – auch als Exportschlager für produzierende Länder. Die Frage ist, ob Menschen sie überhaupt noch steuern sollen. Oder ob künstliche Intelligenz geeigneter wäre. Bleibt die Moral am Boden, wenn Roboter-Drohnen abheben?

Der Brite Stuart Russell will sie verbieten. Russell ist einer der Vordenker der Künstlichen Intelligenz. Der Informatiker ist nicht allein mit seinen Bedenken. „Wenn wir Maschinen erlauben, Menschen zu töten, hätte das schreckliche Folgen für unsere Sicherheit und Freiheit“, sagt Russell im Gespräch mit dem Tageblatt. Tausende Wissenschaftler teilen seine Sorgen und unterstützen ihn. Russell ist wenig optimistisch. Wohl zu Recht. Bereits am Donnerstag haben die USA in Genf einem Verbot die Absage erteilt.

Um zu verstehen, was das bedeutet, müssen wir einen Schritt zurückgehen.

Aus modernen Kriegen sind Drohnen längst nicht mehr wegzudenken. Surrend nähern sie sich ihren Zielobjekten. Klein sind die Geräte nicht. Die gängigen Modelle haben Spannweiten von mehr als zehn Metern. Meist tragen sie mehrere lasergesteuerte Raketen. Größere Modelle lassen sich per Satellit aus Tausenden Kilometern Entfernung lenken. Meistens aber sitzt kaum hundert Kilometer entfernt ein Drohnenpilot in einem Jeep oder auf einem Stützpunkt und steuert sein Flugobjekt per Joystick und Bildschirm. Ohne sich selber in Gefahr zu bringen. Es sieht ein bisschen aus wie ein Computerspiel. Drohnen sind billiger als Kampfflugzeuge, die Ausbildung der Piloten dauert kürzer. Sie sind vergleichsweise präzise. Und sie sind sehr tödlich. Unter den Opfern sind zahlreiche Zivilisten.

Ist KI menschlicher?

Wären solche Opfer vermeidbar, wenn nur Künstliche Intelligenz entscheiden würde? Über Anflugrichtung, Zielerfassung und schließlich den Abschuss – oder eben den Nicht-Abschuss.

Auch Luxemburg ist bei dem UN-Treffen in Genf vertreten, dem – so die genaue Bezeichnung – „Group of Governmental Experts on Lethal Autonomous Weapons System“ (GGE LAWS) im Rahmen der „Convention on Certain Conventional Weapons“ (CCW). Dass ein Verbot für den Einsatz Künstlicher Intelligenz in Waffensystemen in die Wege geleitet würde, das Luxemburg unterstützt hätte, wie das Verteidigungsministerium gegenüber dem Tageblatt sagt, galt im Vorfeld als unwahrscheinlich. Denn Drohnen sind effizient. Und sie stellen ein Riesen-Business dar. Für einige Staaten sind sie zu Statussymbolen geworden. Mit Drohnen wird nicht nur geballert. Mit ihnen wird auch geprotzt.

Das Geschäft mit dem ferngesteuerten Kriegsgerät wächst. In den letzten Jahren mussten immer mehr Menschen auf dem Boden Bekanntschaft machen mit Kampfdrohnen. Diese sogenannten „Unmanned Combat Aerial Vehicles“, kurz UCAV, wurden zuletzt in einer ganzen Reihe von Konflikten eingesetzt. In der Ostukraine kämpfen pro-russische Separatisten seit Jahren mit Mini-Drohnen, Kiew flog am vergangenen 26. Oktober erstmals einen Angriff mit einer Kampfdrohne. Den Kriegsverlauf in Libyen haben sie mitgeprägt. Sie kamen in Syrien, Irak, Afghanistan, der Türkei und auf den Philippinen zum Einsatz. Ebenso in Mali und Burkina Faso, zwei Partnerländern der Luxemburger Entwicklungszusammenarbeit, sowie in Nigeria, Somalia, Saudi-Arabien, in Jemen, Pakistan, Israel, Gaza und dem Libanon. Sie sorgten überall für Schrecken, ließen Konflikte in eine Richtung kippen.

Makabre Internethits

Eine auch medial gesteigerte Aufmerksamkeit verschaffte ihnen der Krieg um Bergkarabach zwischen Armenien und Aserbaidschan im Herbst 2020. Das war durchaus so gewollt.

Die Türkei unterstützte Aserbaidschan in seiner Offensive auf die umstrittene und unwegsame Region. Ankaras Hilfsangebot an Baku bestand vor allem aus in der Türkei hergestellten Kampfdrohnen. Die auf Social Media verbreiteten Schreckensvideos von Truppenbombardierungen wurden zum makabren Internethit – der Krieg um Bergkarabach so zum Werbefilm für die Rüstungsindustrie der Türkei. An der Bayraktar TB2 zeigen seither immer mehr Staaten Interesse. Die Kampfdrohne, die der türkische Präsident Recep Tayyip Erdogan bei Fototerminen gerne persönlich signiert, ist der Exportschlager der wachsenden heimischen Rüstungsindustrie. Ein Nachfolgemodell, um einiges mächtiger als die TB2, steht schon bereit.

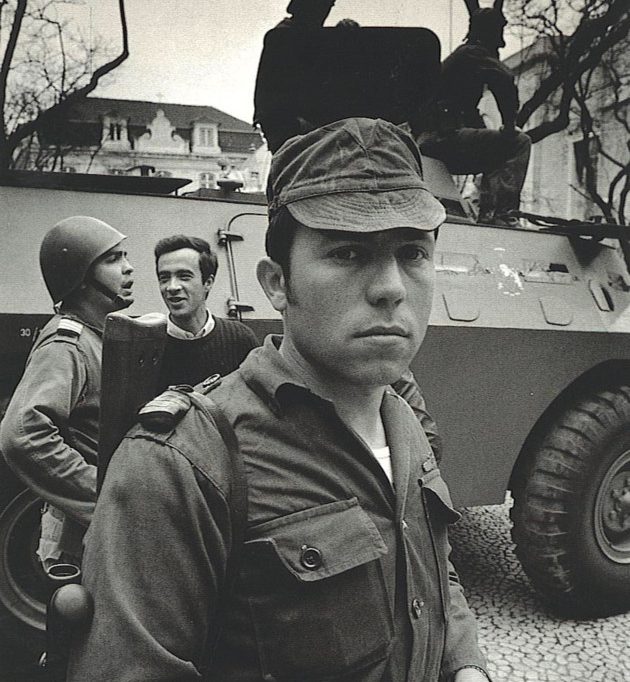

Das Tageblatt berichtete vergangenes Jahr aus dem Krieg um Bergkarabach. In einem sandigen Schützengraben an der Front unweit des da bereits zerbombten Städtchens Martuni begegneten wir Hayk und dreien seiner Freunde. Die jungen Männer waren bis vor kurzem noch Zivilisten. Jetzt standen sie als Freiwillige in geborgten Uniformen und in Turnschuhen an der Front. Sie gaben sich noch selbstbewusst, obwohl da schon fast alles auf eine baldige Niederlage hindeutete. Während wir redeten, erklang das Surren, das die jungen Männer sofort erschaudern ließ. „Run! Run!“, entfuhr es Hayk. Alle folgten seinem Befehl. Die Drohne flog weiter. Armeniens Soldaten hatten den unbemannten Fluggeräten aus Aserbaidschan nichts entgegenzusetzen, als auseinander zu laufen und sich in den Sand zu werfen. Die Rechnung war schnell gemacht: Ein einzelner Soldat lohnt sich nicht zum Abschuss – ein ganzer Pulk schon eher.

In den ersten Tagen der Auseinandersetzung zerschoss das rohstoffreiche Aserbaidschan mit der vollen Feuerkraft seiner aufgemotzten Streitkräfte die ersten armenischen Verteidigungslinien. Damit verloren die Armenier auch einen Großteil jenes Kriegsgeräts zur Luftabwehr, das im weiteren Gefechtsverlauf vielleicht etwas Schutz geboten hätte gegen die ferngesteuerte Gefahr von oben. Fortan gab es keine wirkliche Gegenwehr mehr gegen die Angriffe aus der Luft – es ging nur mehr ums Ausweichen. Das ist die andere Seite eines riesigen Geschäftes, in dem längst nicht nur die Türkei mitspielt. Die Spirale losgetreten haben die USA.

Man hat schließlich auch den Einsatz chemischer Waffen verboten, ohne die Forschung in der Chemie abzuschaffen

Es war der 7. Oktober 2001, als die Welt ein erstes Mal einer Kampfdrohne im Einsatz ihre Aufmerksamkeit schenkte. Die Terroranschläge auf die Twin Towers waren vier Wochen her, die USA hatten den Taliban bereits den Krieg erklärt. Von amerikanischem Boden aus steigt die Predator „RQ-1“ zu ihrem Premieren-Angriff auf. Aus 11.000 Kilometern Entfernung steuern die US-Verantwortlichen die Kampfdrohne auf die afghanische Stadt Kandahar zu – und verfehlen ihr Ziel, den Taliban-Chef Mullah Mohammed Omar. Die Premiere misslingt, US-Präsident George Bush ist dennoch angetan vom neuen Kriegsgerät. „Wir sollten uns 50 von denen zulegen!“, sagt Bush. Inzwischen verfügen die USA über mindestens 400 Reaper-Drohnen, dem Nachfolgemodell der Predator.

20 Jahre später hat sich nicht nur die Türkei neben den USA und Israel im Exportmarkt für Kampfdrohnen breitgemacht. Auch China und der Iran exportieren fleißig ihre vergleichsweise günstigen UCAVs. In Europa hat zum Beispiel Serbien bereits chinesische Modelle gekauft – und weitere aus der Türkei bestellt. Der Iran liefert vor allem an radikalen Gruppen wie die Hisbollah im Libanon, die Hamas in Gaza und die Houthi-Rebellen in Jemen. Inzwischen dürften rund 40 Staaten im Besitz von Kampfdrohnen sein. Die USA schreckten lange vor Exportgeschäften zurück, auch wegen internationaler Verpflichtungen im Rahmen der Nicht-Aufrüstung. Russland hat seine Aufholjagd erst in den vergangenen Jahren begonnen. Bei den Exporten spielt auch der Preis eine Rolle. Amerikanische Systeme kosten locker das Zehnfache eines türkischen oder chinesischen Modells, die mit rund fünf Millionen Euro veranschlagt werden. Wobei der Preis stark schwankt – je nachdem, welche Waffensysteme, Bodenstationen und Pilotenausbildungen mitbestellt werden. Auch für weit weniger als fünf Millionen Euro können Staaten ihre Armeen mit Kampfdrohnen ausstatten.

Die EU tut sich schwer

Die Europäische Union ringt seit knapp 20 Jahren um den richtigen Umgang mit dem Thema. Ein EU-weites Programm zum Bau einer bewaffneten Drohne steht aus. Einige Staaten beschreiten eigene Wege. Im Mai einigten sich Frankreich, Spanien und Deutschland über die weitere Entwicklung des „Future Combat Air Systems“. Mehr als 100 Milliarden Euro sollen in einen Kampfjet investiert werden, der gemeinsam mit einem Drohnenschwarm Angriffe fliegen kann. Die Fertigstellung ist für 2030 geplant. Alles schaut danach aus, dass es länger dauern wird.

Die schlechte Ausstattung in der EU liegt an nationalen Uneinigkeiten – aber auch an ethischen Fragen. Diese bekommen mit dem Einsatz von Künstlicher Intelligenz eine weitere Dimension. Australien, die USA, China und Russland arbeiten an unbemannten Kampfdrohnen, die im Schwarm auftreten und selbstständig angreifen sollen. Peking soll bereits über eine Drohne verfügen, die autonom feindliche Ziele ausmachen kann.

Gegen KI hat der Mensch keine Chance

Was theoretisch möglich ist, zeigte ein Experiment der US-Rüstungsforschungsagentur Darpa im vergangenen August. In einer Simulation namens „Alpha Dog Fight“ trat ein Pilot in einem F-16-Kampfjet gegen ein von KI gesteuertes Flugzeug an. Rasch stellte sich heraus: Gegen die Maschine hat der Mensch keine Chance. Die Drohne beantwortete die Manöver des Piloten präzise und mit rasender Geschwindigkeit – selbstverständlich ohne zu ermüden.

Das Duell endete mit der klaren Niederlage für den Menschen: null zu fünf Abschüsse. Noch finden Szenarien wie diese ausschließlich im virtuellen Raum statt, in der Realität steht man noch vor erheblichen Problemen. So braucht es bei autonomen Kampfdrohnen, die mit Algorithmen eigene Entscheidungen treffen, zwar keine Datenübertragung nach außen. Doch auch sie müssen ständig Informationen verarbeiten, was viel Energie kostet und nach langlebigen, leichten Batterien verlangt.

Das bringt uns zurück zu Stuart Russell. Seit fast 40 Jahren befasst sich der Brite mit Künstlicher Intelligenz und wird nicht müde, vor den Gefahren autonomer „Killer-Roboter“ zu warnen. Von Künstlicher Intelligenz gesteuerte Kampfdrohnen folgen Algorithmen – sie planen ihre Angriffe, suchen und töten von selbst. Der Mensch wäre aus der Entscheidungsfindung über Leben und Tod herausgenommen. „Es geht um jene vollautomatisierten Kriegswaffen, die ihr Ziel ohne menschliche Kontrolle auswählen“, erklärt der 59-Jährige sein Verbotsvorhaben. Sollten solche Waffen irgendwann in hoher Stückzahl hergestellt werden, könnten sie leicht in die falschen Hände geraten, befürchtet Russell. „Wir verkaufen ja auch keine Atomwaffen im Supermarkt.“

Eigenständig tötende Waffen mögen für manche noch nach Science-Fiction klingen. Dabei wurden sie bereits in zahlreichen Konflikten eingesetzt, darunter auch jenem um Bergkarabach. Experten sprechen in dem Fall von „Loitering Munitions“, geläufiger dürfte der Begriff „Kamikaze-Drohnen“ sein. Es handelt sich dabei um kleine, autonome Drohnen, die lange über einem Gebiet kreisen und sich jederzeit auf ein Ziel stürzen können.

Neben den türkischen TB2-Kampfdrohnen hatte auch jenes Heulen der vom Himmel herabschießenden Kamikaze-Drohnen einen zermürbenden Effekt auf die armenischen Truppen. Das Gefühl, nirgends mehr sicher zu sein, war allgegenwärtig. Tausende armenische Soldaten desertierten bereits in den ersten Kriegstagen. Nach sechs Wochen war der Krieg verloren.

Doch wie geht es weiter? Sollen künftig auch Drohnen, Kriegsschiffe, Panzer oder Roboter-Soldaten gesteuert von Künstlicher Intelligenz in den Krieg ziehen?

Es gibt auch andere Mittel, per Knopfdruck zu töten, das ist nichts, das wir erst seit der Entwicklung von Drohnen kennen

Militärstratege Franz-Stefan Gady vom Institute for International Strategic Studies (IISS) in London und New York hegt keine größeren Bedenken. „Es gibt auch andere Mittel, per Knopfdruck zu töten, das ist nichts, das wir erst seit der Entwicklung von Drohnen kennen“, sagt der 39-Jährige, der auch Regierungen berät. Seit dem Mittelalter versuchten Soldaten, ihre Distanz zum Gegner zu vergrößern. Von einem Verbot autonomer Waffen hält Gady nichts. Drohnen jeglicher Art würden ihre Stärke immer erst in Verbindung mit anderen Waffensystemen entfalten, das sei auch in Bergkarabach der Fall gewesen. Man dürfe die Rolle von Drohnen nicht überschätzen – sie ersetzten keinesfalls eine moderne Luftwaffe, zudem gebe es durchaus die Möglichkeit, sie abzuschießen. Verschiedene Waffengattungen möglichst gut miteinander zu kombinieren, werde „auch in Zukunft das effektivste Mittel in der Kriegsführung sein“, sagt Gady.

Freunde der Killerroboter

Doch hält die Künstliche Intelligenz Einzug in Angriffswaffensysteme, stellt sich ein weiteres Problem: Die KI würde ihre Entscheidungen rasend schnell treffen. Zu schnell für Menschen, um mithalten und zur Not eingreifen zu können. Sollte demnach nicht doch ein Strich gezogen werden – dort, wo die Entscheidung über Leben und Tod an die Maschine ausgelagert wird und der Mensch nicht mehr eingreifen kann?

Sogar Stuart Russell, als Vorkämpfer des Verbotes, ist pessimistisch: „Ein Verbot, sollten sie überhaupt eines beschließen, wird eher zahnlos sein.“ Der Brite befürchtet eine endlose Debatte darüber, was der Begriff „vollautonome Waffe“ überhaupt beinhaltet. „Am Ende werden sie wohl etwas verbieten, das ohnehin nie existieren wird.“ So habe etwa Berlin bei der UN-Konvention zu KI in bewaffneten Konflikten darauf bestanden, dass eine Maschine erst dann als vollautonom gelten soll, wenn sie über ein eigenes Bewusstsein verfügt. „Die politischen Richtlinien“, sagt Russell, „ergeben überhaupt keinen Sinn.“

Russell ärgert sich über die Ausreden der Politiker. Viele behaupteten, ein Verbot sei nicht möglich, weil es die KI-Forschung für zivile Zwecke einschränken würde. Dabei gehe es um autonome Kriegswaffen, darunter auch Panzer und U-Boote, sagt Russell: „Man hat schließlich auch den Einsatz chemischer Waffen verboten, ohne die Forschung in der Chemie abzuschaffen.“

Die Amerikaner haben bereits am ersten Tag in Genf einem Verbot eine Absage erteilt. Unter anderem Indien hat sich auf ihre Seite gestellt. Der US-Unterhändler plädierte am Donnerstag der Konferenz für einen nicht bindenden Verhaltenskodex, das müsse reichen. Den Killerrobotern dürfte weiter der rote Teppich ausgelegt werden. Es könnte ein blutroter werden.

KI (künstliche Intelligenz) gegen ND (natürliche Dummheit)!

Können wir keine Kampfdrohnen einsetzen um Querdenker aus der Luft zwangszuimpfen?